Compartir:

Las empresas de diversos sectores están adoptando los modelos de lenguaje grande (LLMs) para desarrollar aplicaciones de inteligencia artificial generativa que brindan experiencias innovadoras a sus clientes y empleados. Sin embargo, el desarrollo o ajuste de estos modelos preentrenados requiere recursos computacionales significativos y un esfuerzo considerable en ingeniería. A medida que los tamaños de estos modelos aumentan, el proceso de personalización se vuelve más complejo, prolongado y económicamente inaccesible para muchas organizaciones que carecen de la infraestructura necesaria y del talento especializado.

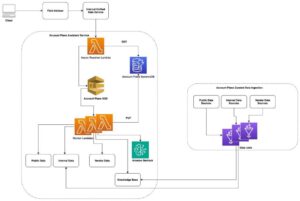

Para abordar estos desafíos, Amazon ha introducido una solución que utiliza el entorno gestionado de Amazon SageMaker para llevar a cabo trabajos de entrenamiento que permiten afinar el modelo Mixtral 8x7B. Este proceso se realiza utilizando PyTorch Fully Sharded Data Parallel (FSDP) y Quantized Low Rank Adaptation (QLoRA), lo cual optimiza el uso de memoria y reduce la huella de los modelos.

El modelo Mixtral 8x7B, reconocido por su arquitectura de «mezcla escasa de expertos» (SMoE), ha ganado popularidad entre grandes empresas por su alto rendimiento en diversas tareas. Esta arquitectura activa selectivamente solo un subconjunto de sus parámetros durante el entrenamiento, utilizando aproximadamente el 18.5% de sus parámetros totales durante la inferencia, lo que optimiza su eficiencia.

Las empresas también enfrentan el desafío de adaptar estos modelos para tareas específicas, ya que los modelos generales carecen de información específica del dominio, lo que limita su desempeño. Implementar estrategias de ajuste fino es crucial para optimizar el rendimiento en aplicaciones concretas, aunque este proceso es intensivo en memoria y requiere una experiencia avanzada en inteligencia artificial.

La solución presentada por Amazon SageMaker utiliza técnicas avanzadas de optimización de memoria para resolver estos problemas. QLoRA, un método que congela los pesos originales del modelo y añade parámetros entrenables de baja jerarquía a las capas de transformadores, permite comprimir el modelo y reducir la memoria utilizada. Esto facilita el entrenamiento y ajuste fino de los modelos de lenguaje grande incluso en sistemas con recursos de memoria escasos, manteniendo un rendimiento comparable al ajuste fino de media precisión.

El uso de QLoRA, junto con SageMaker, ofrece una solución eficaz y rentable para empresas que buscan implementar modelos personalizados de lenguaje grande. Esta implementación permite a las organizaciones centrarse en el desarrollo y perfeccionamiento del modelo utilizando la infraestructura de entrenamiento completamente gestionada proporcionada por SageMaker.