Compartir:

Los modelos de inteligencia artificial generativa han abierto nuevas posibilidades para la automatización y mejora de los flujos de trabajo de desarrollo de software. Particularmente, la capacidad emergente de estos modelos para producir código basándose en indicaciones en lenguaje natural ha revolucionado la forma en la que los desarrolladores y profesionales de DevOps afrontan su labor, incrementando significativamente su eficiencia. En este artículo, ofrecemos una visión general sobre cómo aprovechar los avances de los grandes modelos de lenguaje (LLMs) utilizando Amazon Bedrock para asistir a los desarrolladores en varias etapas del ciclo de vida del desarrollo de software (SDLC).

Amazon Bedrock es un servicio totalmente gestionado que ofrece una selección de modelos base de alto rendimiento de empresas líderes en IA, tales como AI21 Labs, Anthropic, Cohere, Meta, Mistral AI, Stability AI, y la propia Amazon, a través de una única API. Además, Amazon Bedrock proporciona un amplio conjunto de capacidades para construir aplicaciones de IA generativa con seguridad, privacidad y la práctica de una IA responsable.

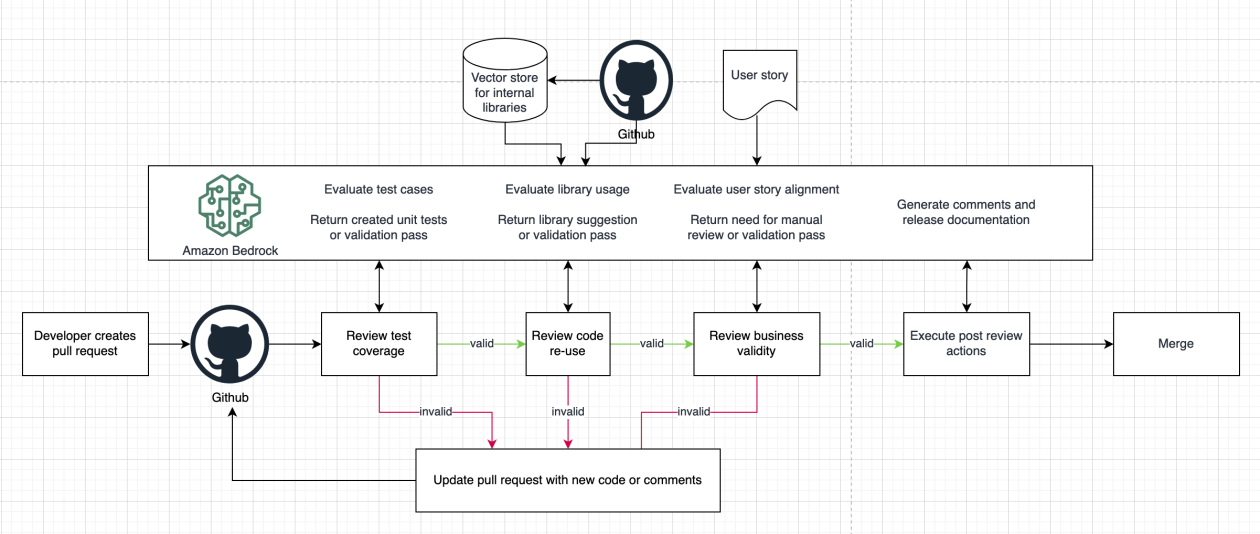

La arquitectura de proceso propuesta en este artículo integra la inteligencia artificial generativa en áreas clave del SDLC para mejorar la eficiencia y rapidez del desarrollo. El objetivo principal es que los desarrolladores puedan crear sus propios sistemas para aumentar, escribir y auditar código utilizando modelos dentro de Amazon Bedrock, en lugar de depender de asistentes de codificación preconfigurados. Entre otros temas, se discuten:

– Un caso de uso de asistente de codificación para ayudar a los desarrolladores a escribir código más rápidamente mediante sugerencias.

– Cómo utilizar las capacidades de comprensión de código de los LLM para generar conocimientos y recomendaciones.

– Un caso de uso de generación automática de aplicaciones para crear código funcional y desplegar cambios automáticamente en un entorno de trabajo.

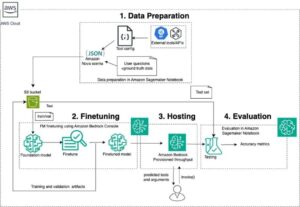

Es crucial considerar algunas opciones técnicas al elegir el modelo y la estrategia para implementar esta funcionalidad en cada etapa. Por ejemplo, la elección del modelo base para la tarea es esencial, ya que cada uno ha sido entrenado con un corpus de datos diferente, afectando el rendimiento en distintas tareas. Modelos como Claude 3 de Anthropic en Amazon Bedrock pueden escribir código de manera efectiva en muchos lenguajes de programación comunes desde el primer momento, mientras que otros modelos pueden necesitar personalización adicional, lo que implica complejidad y mayor esfuerzo técnico.

Los asistentes de codificación son un caso de uso muy popular y existen numerosos ejemplos. AWS ofrece varios servicios para asistir a los desarrolladores, ya sea a través de la finalización en línea con herramientas como Amazon CodeWhisperer o mediante la interacción en lenguaje natural con Amazon Q. Una ventaja clave de un asistente sobre la generación en línea es que permite comenzar nuevos proyectos basados en descripciones sencillas, proporcionando código de ejemplo y recomendaciones sobre qué frameworks utilizar.

La comprensión de código por parte de los LLM puede aumentar la productividad de los desarrolladores individuales al inferir el significado y funcionalidad del código, mejorando la fiabilidad, eficiencia, seguridad y rapidez del proceso de desarrollo. Este enfoque permite la documentación, revisión de código y aplicación de las mejores prácticas de manera más efectiva, y facilita la integración de nuevos desarrolladores en el equipo.

La generación de aplicaciones se puede extender para crear implementaciones completas. En el SDLC tradicional, un humano crea un conjunto de requisitos, diseña la aplicación, escribe el código, crea pruebas y recibe retroalimentación. Los modelos de IA pueden realizar iteraciones del desarrollo al alimentar las salidas del modelo nuevamente como entradas, creando aplicaciones funcionales basadas en indicaciones en lenguaje natural.

Finalmente, destaca la importancia de mantener un sistema modular y flexible para adaptarse a los rápidos cambios en la tecnología. Aprovechar las ganancias en productividad que ofrece la inteligencia artificial será crucial para mantener la competitividad en el futuro cercano.