Compartir:

La inteligencia artificial (IA) está revolucionando los sectores productivos con una rapidez inusitada, impulsando la necesidad de optimizar la eficiencia en la inferencia. Este proceso, fundamental en el funcionamiento de los modelos de aprendizaje automático al permitirles realizar predicciones o decisiones, demanda un alto nivel de cómputo que en ocasiones supera las capacidades del hardware tradicional.

En respuesta a esta demanda, los aceleradores de hardware se presentan como una solución innovadora, proporcionando mejoras significativas en rendimiento, flexibilidad y tiempo de iteración en la inferencia de IA. Dispositivos como las GPUs (Unidades de Procesamiento Gráfico), NPUs (Unidades de Procesamiento Neuronal), FPGAs (Matrices de Puertas Lógicas Programables en Campo) y ASICs (Circuitos Integrados de Aplicación Específica) se destacan por su capacidad para acelerar el procesamiento de IA mediante su arquitectura optimizada y su capacidad de operar en paralelo.

El desafío principal en la inferencia de IA radica en la ejecución eficiente de operaciones matemáticas complejas, como las multiplicaciones de matrices, que requieren una gran capacidad de cálculo. A pesar de la potencia de las CPUs tradicionales, estas no están diseñadas para manejar dichas cargas de manera eficiente, lo que genera un alto consumo energético y velocidades limitadas. Con modelos de IA cada vez más complejos y conjuntos de datos más grandes, la necesidad de hardware especializado se hace más evidente.

El rendimiento óptimo en la inferencia de IA depende de un equilibrio entre la capacidad de cómputo y el ancho de banda de memoria. Mientras que la capacidad de cómputo determina la velocidad del procesamiento de modelos complejos, el ancho de banda de memoria controla la rapidez en la transferencia de datos entre la memoria y las unidades de procesamiento. La evolución de los modelos de redes neuronales, como las CNNs y los transformadores, ha impulsado el desarrollo de aceleradores diseñados para maximizar el potencial computacional del hardware al tiempo que se enfrentan a las limitaciones de memoria.

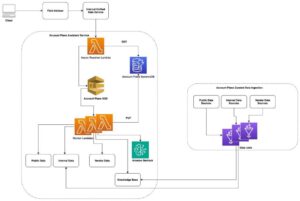

Estos aceleradores ofrecen diversas opciones de implementación, permitiendo su despliegue en instalaciones locales, centros de datos o en el borde, lo que les proporciona una flexibilidad invaluable para adaptarse a diferentes necesidades. Entre sus principales ventajas, destaca su capacidad para mejorar significativamente el rendimiento computacional. Las GPUs, por su parte, con su capacidad de procesamiento paralelo, son ideales para manejar operaciones masivas típicas de la inferencia de IA, reduciendo considerablemente el tiempo necesario para las predicciones.

Por otro lado, las NPUs, optimizadas para tareas de aprendizaje profundo, proporcionan mejoras de rendimiento superiores en determinadas aplicaciones. Al especializar el hardware para operaciones específicas, como multiplicaciones de matrices, las NPUs logran una eficiencia y rendimiento notablemente superiores en comparación con los procesadores generales.

Asimismo, las FPGAs ofrecen una ventaja única gracias a su capacidad de reconfiguración, permitiendo una adaptación del hardware acorde a las necesidades de cada aplicación. Esto las convierte en una opción altamente eficiente para cargas de trabajo en IA, especialmente en situaciones donde la latencia baja es crucial, como en sistemas en tiempo real.

En conclusión, los aceleradores de hardware están revolucionando el campo de la inferencia de IA, garantizando mejoras en flexibilidad, rendimiento y eficiencia. Como una parte esencial de la infraestructura moderna, estos dispositivos permiten a las aplicaciones de IA enfrentar las exigencias del entorno actual, caracterizado por datos intensivos y requerimientos en tiempo real.