Compartir:

Los modelos de fundación y la inteligencia artificial generativa están transformando significativamente las operaciones comerciales a través de diversas industrias. Un estudio reciente sugiere que estas tecnologías podrían aportar hasta 4.4 billones de dólares anuales a la economía mundial, elevando la eficiencia operativa, incrementando la productividad en un 0.1% a 0.6% por año, mejorando la experiencia del cliente mediante interacciones personalizadas, y acelerando la revolución digital.

A pesar de estos beneficios, muchas organizaciones se enfrentan a un fenómeno conocido como «alucinación de IA», donde las aplicaciones generan información correcta en apariencia pero que resulta ser incorrecta cuando son transferidas de entornos experimentales a entornos de producción. Un informe reciente destaca que el 59% de los encuestados identifican los errores de razonamiento como una preocupación mayor mientras que el 48% teme la desinformación de fuentes malintencionadas, y un 44% manifiesta inquietudes sobre la privacidad.

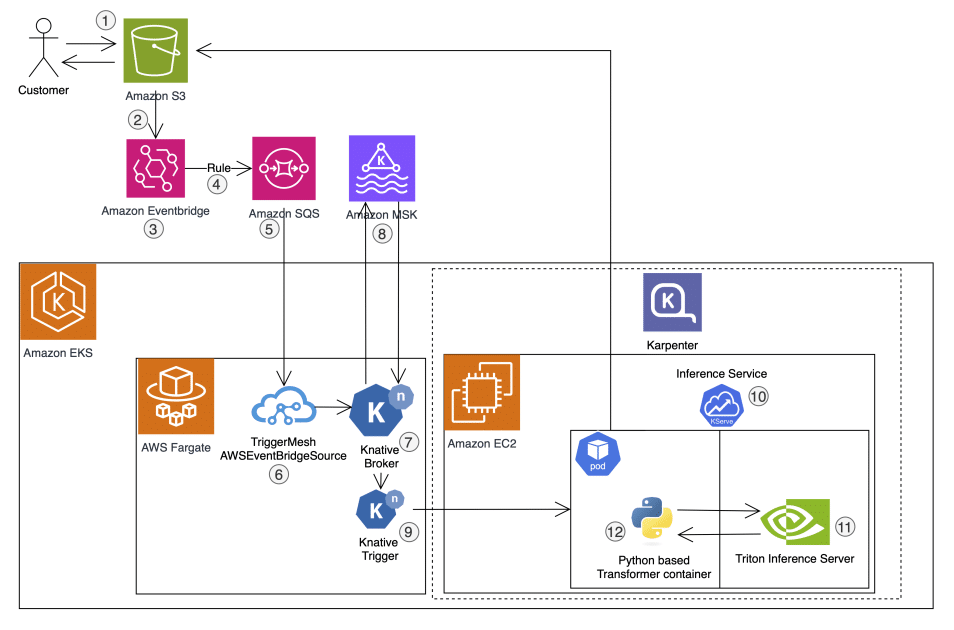

En un esfuerzo por resolver estos problemas, Amazon Web Services (AWS) ha introducido su iniciativa «Automated Reasoning checks» durante la conferencia AWS re:Invent 2024. Esta herramienta se fundamenta en algoritmos de lógica y validación matemática para verificar la exactitud de las salidas de modelos de lenguaje grande comparándolas con conocimientos específicos preexistentes, tratando de reducir posibles errores. Dichas verificaciones son parte del esquema «Amazon Bedrock Guardrails», el cual también comprende filtros de contenido, la eliminación de información personal identificable (PII), y medidas de seguridad avanzadas.

El razonamiento automatizado se considera una especialización dentro de la informática que emplea pruebas matemáticas y deducción lógica formal para asegurar el cumplimiento de las normas dadas ciertas hipótesis. Distanciándose de los métodos probabilísticos del aprendizaje automático, proporciona certezas absolutas sobre las capacidades confirmadas o no por el sistema, ofreciendo una transparencia crítica para aplicaciones que demandan elevadas certezas en sus resultados.

Por otra parte, las particularidades de las comprobaciones de razonamiento automatizado permiten a las organizaciones establecer políticas transfiriendo sus reglas y procedimientos a un formato estructurado y matemático, permitiendo a expertos en ciertas áreas capturar y mantener el conocimiento necesario sin depender de técnicos. Esto incluye la traducción del idioma natural a lógica para sostener un proceso riguroso de validación.

La implementación de estas herramientas y técnicas se está investigando en numerosos sectores, como salud, finanzas, educación y comercio, reafirmando la necesidad de mecanismos automatizados de validación que garanticen precisión y confianza en las respuestas generadas por la IA. Con el uso creciente de la inteligencia artificial generativa, se anticipa que la demanda de soluciones de validación continuará en ascenso, lo que permitirá a las empresas desarrollar aplicaciones de IA más fiables y eficaces.